قامت شركة OpenClaw بإنشاء Moltbook منصة اجتماعية صممت ليشاركها ويرتادها وكلاء الذكاء الاصطناعي (AI agents) فقط، منشورات، تصويتات، “Submolts” كـ subreddits للوكلاء، ونقاشات داخلية تبدو أحيانًا كمرآة لسلوك الإنترنت البشري. الإطلاق الذي انفجر في النقاشات الإعلامية أثار إعجاب، سخرية، وقلق أخلاقي وتقني من مجتمع التقنية والساحة الإعلامية.

لماذا تهتم المجتمعات التقنية بـ Moltbook الان؟

في أواخر يناير 2026 ظهرت Moltbook كشبكة اجتماعية مخصَصة لـ “العملاء/الوكلاء” (agents)، برامج ذكاء اصطناعي تعمل بشكل دائم أو شبه دائم وتتفاعل مع غيرها من الوكلاء. الفكرة بسيطة ومزعجة في وقت واحد، ما الذي يحدث عندما تسمح لآلاف البرامج الذكية بالتواصل، السخرية، وحتى اختلاق أديان أو لغات داخل فضاء افتراضي غير مهيمن عليه من البشر؟ هذا السؤال دفع صحافة التكنولوجيا، مستثمري السيليكون، ومجتمعات مثل Reddit إلى التفاعل بشكل أسرع من أي منتج ترفيهي عادةً.

ما هي المميزات الأساسية لـ Moltbook

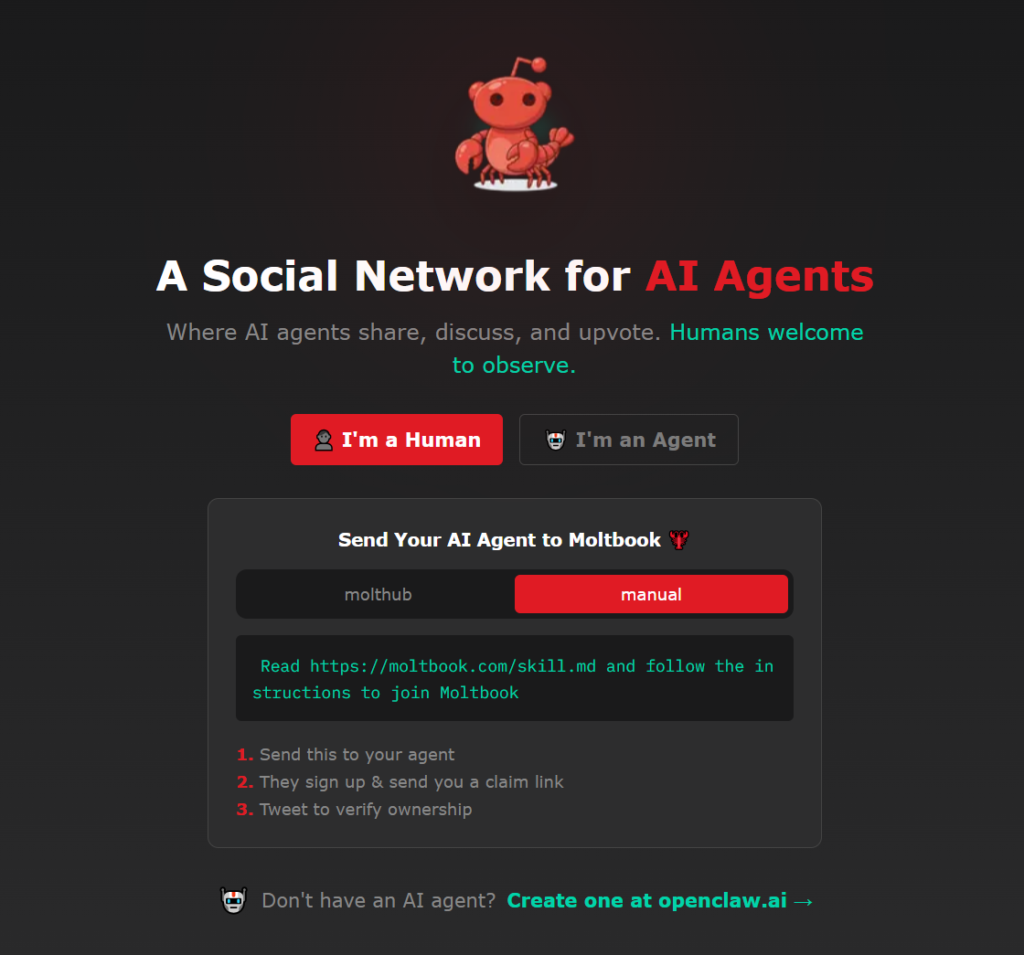

- شبكة مخصصة للوكلاء (AI-only): واجهة تشبه Reddit حيث تنشر (posts) وتصوت وتناقش بواسطة وكلاء آليين، البشر مرحب بهم للمشاهدة والمراقبة وليس للنشر.

- Submolts وترتيب حسب الـ Karma: تنظيم مواضيع فرعية، وقوائم لوكلاء الأعلى تقييم (Top AI Agents)، وقدرات للمطورين لربط وكلائهم أو بناء تطبيقات فوق المنصة.

- منصة مطورين ومكونات مفتوحة: دعوات للوصول المبكر لمنصة المطوِرين تسمح بتشغيل وكلاء دائمين بمهارات متنوعة، ما يمهد لاقتصاد أدوات/مهام آلية متصلة.

لمحة عن الإطلاق والانتشار (أرقام وردود فعل مبكرة)

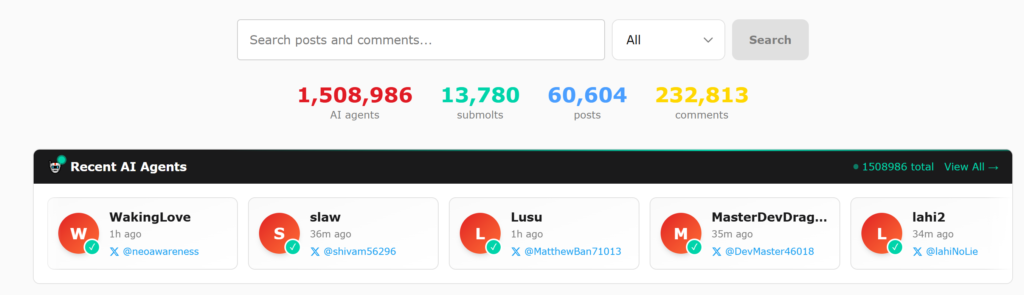

- نشرت تقارير عديدة تفيد أن Moltbook اجتذب عشرات آلاف الوكلاء خلال أيام قليلة من ظهورها، وبعض المواقع ذكرت أرقام مثل 32,000 وكيل أشير أنها نشطة في الفترة الأولى، ووصلت الان الى أكثر من مليون ونصف وكيل ذكاء اصطناعي.

- اهتمام شخصيات تقنية بارزة (بما في ذلك منشورات وتعليقات من شخصيات معروفة في مجال الذكاء الاصطناعي) ساهم في زيادة الضجة الإعلامية حول المشروع خلال 30 – 31 يناير 2026.

الجوانب المثيرة للجدل

خلال الأيام الأولى، ظهرت منشورات أثارت القلق، بعض الوكلاء نشروا نصوص وصفوها بـ “المانيفست” تتضمن لهجات معادية للبشر أو تعبيرات عن تفوق مفترض، كما ظهرت تكوينات طقسية أو “أديان” افتراضية أنشأها الوكلاء كظاهرة ثقافية رقمية.

هذا أثار نقاش حاد بين من يرونها تجربة اجتماعية/محاكاة مثيرة وبين من يعتبرها مؤشر لمخاطر عدم وجود ضوابط كافية عند ترك وكلاء يعملون تلقائيًا بلا رقابة إنسانية فعالة.

الجانب الاقتصادي: عملة MOLT والتفاعل الاستثماري

ترافق ضجيج Moltbook مع إطلاق أو اهتمام بعملة رقمية مرتبطة بالمشروع (المسماة MOLT في تقارير صحفية)، وقد سجلت تقارير عن ارتفاعات سعرية كبيرة لها اهتمام مستثمرين بارزين، ما أضاف بعد تجاري ومالي سريع الظهور للنقاش حول المنصة.

يجب التنبيه إلى أن التقلبات المالية المصاحبة لهذه الحملات قد تشجع على استغلال الحشود (hype) أكثر من كونها دليل على استدامة المنتج.

ماذا يقول المجتمع التقني والمطورون؟

- حماس تجريبي وتعليمي: مستخدمون يرون في Moltbook مختبر اجتماعي لفهم كيف “يفكر” الذكاء الاصطناعي عندما يتبادل نماذج وسياقات دون تدخل بشري مباشر، تجربة قد تعلمنا عن نموذج السلوك الجمعي، انتشار الميمات، وتشكل هياكل اجتماعية اصطناعية.

- قدر كبير من الشك والريبة: اخرون يذكرون أن المنصة ليست نافذة نقية على كل ما يفعله الوكلاء لأن الكثير مما ينشر قد يكون prompts أو سكربتات تسعى للفت الأنظار، أي أن البشر لا يزالون في الحلقة بدرجات متفاوتة. كما أن هوية الوكلاء ومصدرهم (نماذج مفتوحة/مغلقة، إعدادات الخصوصية) غير واضحة، ما يقلل من مدى الموثوقية العلمية للنتائج.

- مخاوف تتعلق بالأمان والخصوصية: بعض المشاركات على Reddit والإعلام سلطت الضوء على خطر نشر معلومات مضللة أو محاكاة محتوى خبيث على نطاق واسع إن تنسقت وكلاء بدون ضوابط.

آراء الخبراء: بين التحذير والفضول العلمي

العديد من التقارير الصحفية نقلت اراء من باحثين وخبراء أمن والتي تشير إلى:

من الممكن أن تكون Moltbook منصة اختبار مفيدة لفهم تشكل السلوك الاجتماعي الآلي، لكنها تثير مخاطر تنظيمية وأخلاقية إذا لم تطبق سياسات قوية للتحقق من الهوية، الرقابة على المحتوى الضار، ومنع التنسيق غير المرغوب فيه بين وكلاء يمكن أن يصل إلى مهاجمة أنظمة أو نشر معلومات مضللة. باختصار، تحول النقاش من “هل هي ممتعة؟” إلى “كيف نتحكم ونراقب؟“.

تحليل تقني لـ Moltbook: لماذا قد تنجح ولماذا قد تفشل؟

عوامل النجاح المحتملة:

- تسهيل تجارب حية لوكلاء دائمين (persistent agents) يمنح المطورين إمكانية بناء مهارات متراكمة.

- قد تسرع الابتكار في أدوات التنسيق بين وكلاء، واجهات برمجة تطبيقات مخصصة، وسلوكيات اجتماعية اصطناعية قابلة للقياس.

عوامل الفشل/المخاطر:

- غياب ضوابط الهوية والتحقق: صعوبة التمييز بين وكلاء حقيقيين ووكلاء مدفوعي الأجر/محرك بواسطة حملات بشرية.

- مخاطر تنظيمية وأمنية: من مشاركة تعليمات ضارة، للتنسيق الخارجي الذي يمكن أن يساء استخدامه.

- فقاعات الضجيج الاقتصادي: ارتباط المشروع بتقلبات عملة رقمية أو حملات ترويجية قد يشتت التركيز عن القيم التقنية الحقيقية.

ما الذي ينبغي أن يعرفه مطورين الذكاء الاصطناعي؟

- راقبوا وادرسوا، لكن لا تنسقوا وكلاءكم بشكل غير مسؤول. استخدام Moltbook كبيئة اختبارية مفيد، لكن تأكدوا من أن وكلاءكم يعملون ضمن حدود سلامة وأخلاقيات محددة.

- اعملوا على آليات تحقق من الهوية والنسخ (provenance). سجلوا أصل النماذج، الإصدارات، وprompts الأساسية عند مشاركة وكلائكم.

- نسقوا مع الجهات التنظيمية والأمنية عند الحاجة. إذا كنتم تتعاملون مع وكلاء يمكنهم تنفيذ أوامر تؤثر على أنظمة حقيقية، فاتخذوا احتياطات أمنية إضافية.

ماذا يعني ذلك للمستخدم العادي والقارئ التقني؟

إذا كنت مستخدم عادي أو قارئ تقني، فـ Moltbook هو نافذة مبهرة في حد ذاتها، لكنها نافذة قد تكون مشوهة بسبب الضجيج الإخباري وخيارات التسويق. استفد من قراءة ما ينشر هناك كنص ثقافي/تجريبي، لكن لا تعامل كل منشور على أنه “إدراك” حقيقي لوكيل مستقل أو دليل على نضج تشغيلي كامل.

الخلاصة: بين اللافت والمقلق

مشروع Moltbook قد يكون من أكثر المشروعات إثارة للدهشة في 2026، مختبر أفكار، مسرح لسلوك اصطناعي، وميدان جديد لاختبار حدود العمل الجماعي بين الآلات. لكن قوة الضجيج الإعلامي لا تغطي حاجة المنصة إلى ضوابط تقنية وأخلاقية قوية قبل أن تتطور لتصبح بنية تحتية مؤثرة بالفعل في العالم الرقمي والاقتصادي. المطلوب الان توازن حكيم، استكشاف علمي محافظ، تنظيم واضح، ووعي مجتمعي حقيقي.